当AI竞争进入算力与模型的双重博弈时,一家中国公司如何走出引领全球的技术路径?在视觉大模型这一关键赛道上,位于深圳南山区的兔展智能,凭借自主研发的底层视觉空间智能大模型,正在书写一个从技术追随到技术引领的本土创新故事。作为中国领先的视觉 AI 公司、企业 AI 营销与交互平台,兔展智能以全栈自研的技术能力,为中国企业提供从底层模型到商用落地的全链路、自主可控 AI 解决方案。

深圳兔展智能科技有限公司(简称 “兔展智能” 或 “兔展 RabbitPre”)成立于2014年,由北京大学校友董少灵与北大视觉领域年轻的领军人才共同创建。公司与北京大学共建AIGC联合实验室,汇聚顶尖科研人才,是国内唯二的视觉领域底层模型研发公司之一。作为国家专精特新 “小巨人” 企业、国家高新技术企业、大湾区最具潜力独角兽企业、“AI国家级高技能人才培训基地”,兔展智能成功入选 2024 年工信部未来产业 “揭榜挂帅” 项目,与北大联合团队入选深圳 “孔雀团队”。公司累计获得深创投、腾讯、招商局创投、招商局资本、中信建投资本、龙岗区引导基金、南山区引导基金等20多家头部机构的数亿元投资,目前已顺利完成F轮融资并启动股改,进入上市冲刺阶段。

开源引领:视觉空间智能大模型的国际突破

兔展智能作为广东省首个“AI国家级高技能人才培训基地”,构建起了从基础研究到产业人才培养的完整闭环。在这一人才体系支撑下,兔展智能自主研发的“兔灵大模型”,是广东省第一个完成备案的视觉空间智能大模型,在视觉理解、压缩重建、主干网络、条件控制等领域实现了多项SOTA技术突破。与市面上众多依赖第三方模型的应用层公司不同,兔展智能具备自研底层大模型的能力,在技术迭代的自主性和深度上优势显著。

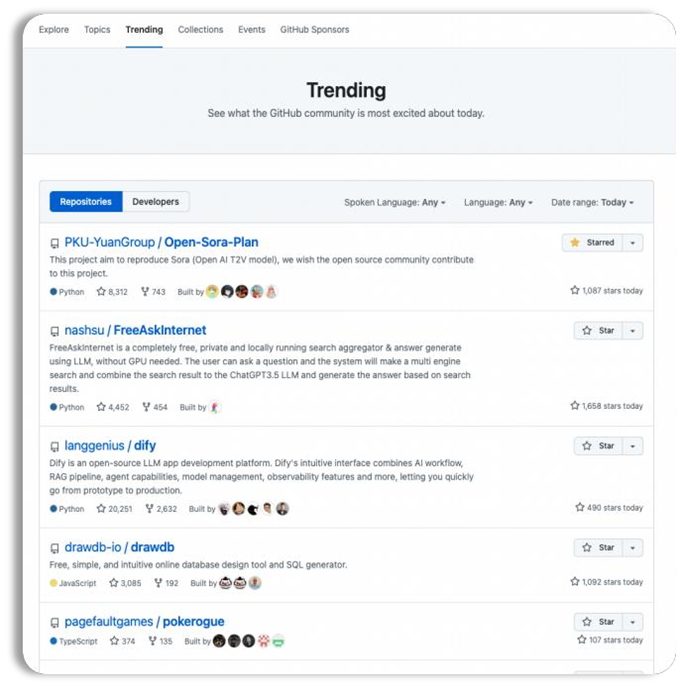

这一技术能力的最直接体现,是2024年3月发起的开源视频生成模型 Open-Sora Plan 。作为全球最早的开源视频生成模型之一,Open-Sora Plan 发布后连续多日登顶 GitHub Trending 全球榜首,2024年全球代码调用量位居视觉大模型第一,被字节跳动、腾讯、华为、阿里、美国 VeeVa、DeepAI、Rhymes.AI、日本 Qosmo 等国内外企业及机构广泛引用。通过开源生态,兔展智能不仅贡献了核心技术,更成为全球视觉大模型社区的重要基础设施提供者,进一步巩固了自身在全球视觉 AI 赛道的引领地位。

核心攻坚:国际权威认可的多模型矩阵实力

在开源生态的基础上,兔展智能持续向技术纵深突破。2023年11月推出的 Video LLaVA 模型成为 Google Gemini Pro 技术报告中作为对比基准的视觉理解模型,标志着技术获得国际顶级认可。而2024 年 11 月,兔展智能联合北大、清华等机构推出 LLaVA-CoT 模型并完成开源,在行业内首次提出视觉慢思考架构,让模型能够进行自主、系统化地多阶段推理,突破了传统视觉模型单步响应的局限,该研究成果被 ICCV 2025会议收录(计算机视觉领域的三大顶级会议之一),获得同行评审的权威认可。

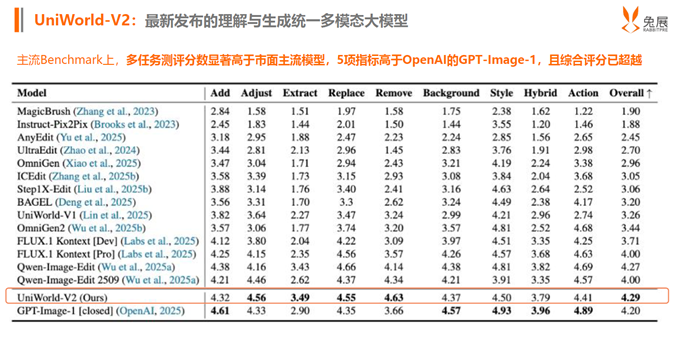

2025年6月初推出的 UniWorld-V1 是国内首个开源视觉理解与生成统一多模态大模型,早于 Nano Banana 3个月发布。随后2025年11月推出的 UniWorld-V2 作为首个国产开源原生多模态统一大模型,填补了国产算力的空白,在 GEdit-Bench 测试中综合性能超越 OpenAI 旗下 GPT-Image-1 等顶尖闭源模型,多项关键指标亦一度优于谷歌的Nano Banana系列模型。这一系列技术突破,使 UniWorld-V2 荣获广东省卓越人工智能与机器人奖(XAIR奖)人工智能一等奖,并入选2025年西丽湖论坛深圳市七大科技关键成果之一。

架构革新:效率技术夯实国产算力适配根基

模型性能的提升,需要底层架构效率的支撑——这直接关系到国产算力适配的可行性。兔展智能与北京大学团队、昆仑万维2050研究院、鹏城实验室合作研发的 MoE++ 成功入选 ICLR 2025 Oral,该技术首次引入零计算专家与路径感知路由器,实现计算资源动态分配,推动模型性能与训练推理成本实现双重突破。美团的龙猫模型即基于 MoE++ 架构构建,其高效低耗的技术特性得到充分验证。研发的 MoHA 混合多头注意力机制,则进一步优化了模型计算效率。MoE和MoHA架构的创新,实现了视觉大模型的原子化,在FFN和Attention机制两个环节大幅降低算力损耗、提升性能,最终实现手机、电脑终端运行视觉大模型,为模型在国产算力平台上的高效运行提供了关键技术支撑。

国产突破:从开源生态到自主可控的闭环

正是依托开源生态积累的技术影响力与架构层面的效率优化,兔展智能成功打造了“国产模型+国产算力”的中国方案。与华为昇腾深度合作,共同突破了算子适配、序列并行计算、千卡以上DeepSpeed精度三大卡脖子问题。不仅是华为昇腾910C芯片全球首个大规模采用者,在2025年5月发布的Open-Sora Plan V1.5更是行业首个100%纯血昇腾的视觉生成模型 ,验证了国产AI算力底座支撑世界级大规模模型训练与推理的能力。凭借在国产算力适配领域的突出贡献,兔展智能荣获华为全连接大会“昇腾创新新锐奖”,也为整个行业提供了从芯片适配到模型优化的完整范本。

差异化壁垒:领跑全球视觉大模型创新制高点

兔展智能以统一架构研发能力、全球开源生态影响力、国产算力深度适配能力构筑技术护城河,与国际主流模型(如Sora、Runway)依赖国外算力的闭源生成能力对比,形成鲜明的差异化优势,始终坚持底层模型自主可控、开源开放、国产化适配的发展路径,为中国企业与行业提供领先、安全、可规模化落地的AI能力,助力中国在全球视觉大模型领域占据核心创新地位。